È stato approvato dal Senato il 17 settembre e, successivamente, pubblicato in Gazzetta Ufficiale il 10 ottobre. È ormai legge un nuovo provvedimento che introduce pene severe per chi diffonde video, immagini o audio creati con l’intelligenza artificiale in modo da ingannare o danneggiare altre persone.

Non è l’IA in sé a finire nel mirino, ma l’uso distorto della tecnologia: i cosiddetti deepfake, quei contenuti falsi ma incredibilmente realistici, diventano ora un reato specifico nel codice penale in determinate casistiche. In un contesto in cui l’AI e il futuro dell’informazione sono sempre più intrecciati, è fondamentale comprendere i confini tra innovazione e reato.

Indice dei contenuti

| Dettaglio normativo | Specifiche di legge |

|---|---|

| Nuovo reato introdotto | Art. 612-quater Codice Penale |

| Pena prevista | Reclusione da 1 a 5 anni |

| Condotta punibile | Creazione e diffusione senza consenso |

| Aggravante specifica | Uso insidioso di sistemi di IA |

Video creati con AI: hanno i giorni contati?

Ci siamo divertiti tutti almeno una volta davanti a dei video creati con AI: gatti che parlano, persone che fanno cose impossibili, personaggi storici catapultati nel presente. Gag e giochi creativi e spesso surreali, dove l’unico limite sono le regole del provider e la fantasia dell’utente che genera il prompt.

Ma non tutti i video, le foto e persino gli audio creati con l’AI nascono per far sorridere. Sempre più spesso, infatti, vengono usati per ingannare, diffamare o manipolare: falsi video di politici o celebrità, dichiarazioni mai pronunciate o contenuti lesivi. Casi recenti di cronaca, come quelli legati al deepfake da Phica.eu al caso Barra e Social Media Girls, dimostrano come le conseguenze possano diventare molto più gravi di una semplice bufala virale.

Cosa dice la nuova norma, in parole semplici

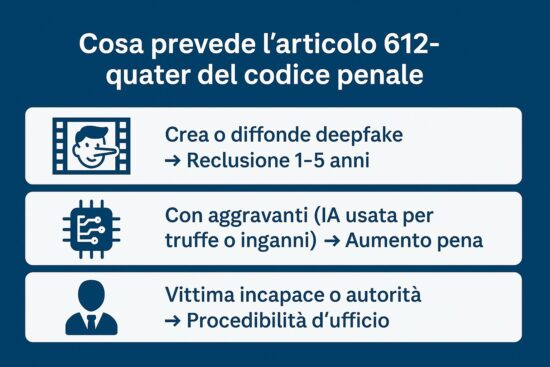

La norma approvata in Senato entra direttamente nel Codice penale con l’art. 612-quater: punisce chi “cedendo, pubblicando o diffondendo” contenuti falsificati con sistemi di IA e idonei a ingannare, causa un danno ingiusto alla persona ritratta/ascoltata, senza il suo consenso. Pena: reclusione da 1 a 5 anni.

Si procede a querela della persona offesa, ma si può procedere d’ufficio se la vittima è incapace (per età o infermità), se si tratta di una pubblica autorità o se il fatto è connesso ad alcuni reati gravi perseguibili d’ufficio.

La cosa importante è che la legge non punisce solo chi realizza un deepfake, ma anche chi lo inoltra, lo pubblica o lo condivide, se contribuisce alla sua diffusione senza consenso. In pratica: non serve essere un hacker per violare la legge, basta condividere un contenuto falso che danneggia qualcuno.

“Aggravante IA”: pene più alte se usi l’IA per delinquere

La legge aggiunge anche una nuova aggravante generale: se commetti un reato “mediante l’impiego di sistemi di IA” in modo insidioso o tale da ostacolare la difesa, le pene aumentano (nuovo n. 11-decies all’art. 61 c.p.). E per alcune fattispecie specifiche (es. taluni reati di inganno) è previsto un aumento mirato. Tradotto: usare l’IA per truffare, manipolare o coprire le tracce diventa più grave.

Alcuni esempi:

-

- Diffondere notizie o video falsi generati da IA su società quotate (es. finti annunci di fallimento o dimissioni di CEO) per alterare il valore dei titoli;

- Creare e diffondere video o audio falsi per screditare persone, giornalisti o istituzioni, sfruttando la credibilità apparente di contenuti realistici;

- Revenge pornography tramite video Deep Fake;

- L’uso di deepfake vocali o visivi per impersonare dirigenti d’azienda (“CEO fraud”), convincere dipendenti a effettuare bonifici o trarre in inganno i clienti.

Insomma, l’uso improprio dell’intelligenza artificiale non è più uno scherzo: la legge ora prevede conseguenze penali concrete, oltre a prevedere una lunga lista di aggravanti.

Cosa può fare chi è vittima di reato tramite video creati con AI?

La persona offesa può chiedere non solo la rimozione del deepfake dalle piattaforme, ma anche il risarcimento dei danni, proporzionato alla gravità dell’offesa e alla diffusione del contenuto. Se la piattaforma rifiuta o ignora la richiesta, il giudice può ordinare la rimozione forzata e vietarne la diffusione futura, oltre a disporre le sanzioni penali ai diretti responsabili. Un dettaglio importante: se la vittima muore, questi diritti passano agli eredi.

Queste direttive si aggiungono a una lunga lista di reati digitali, per così dire “nuovi”, che oggi si possono commettere con una facilità disarmante e che, troppo spesso, vengono sottovalutati.

Oltre ai deepfake, troviamo il cyberbullismo, lo stalking online, la diffusione non consensuale di immagini intime (revenge porn), le frodi informatiche e le truffe tramite phishing o social engineering. Reati che l’intelligenza artificiale rende ancora più insidiosi, automatizzando processi che un tempo richiedevano competenze tecniche elevate — come la clonazione realistica di voci e volti, o la creazione di contenuti manipolati in pochi secondi.

Inoltre si tratta di reati che, pur avvenendo “solo” in rete, possono avere conseguenze reali e devastanti per le vittime — economiche, reputazionali e psicologiche — e che la giurisprudenza sta finalmente iniziando a trattare con la gravità che meritano. Per approfondire il testo ufficiale, è possibile consultare la Gazzetta Ufficiale.

Video creati con AI: un punto di svolta

La nuova legge italiana si muove in sintonia con l’AI Act europeo, approvato nel 2024, che impone regole di trasparenza e tracciabilità per i contenuti generati da IA.

L’Italia, con questa norma penale, diventa uno dei primi Paesi UE a prevedere sanzioni specifiche per chi usa l’intelligenza artificiale in modo ingannevole o dannoso.

Tale legge, inoltre, segna un punto di svolta: riconosce che l’intelligenza artificiale non è un pericolo in sé, ma lo diventa quando viene usata per mentire, manipolare o distruggere reputazioni.

È un invito a tutti — utenti, creatori e piattaforme — a usare l’IA con responsabilità, ricordando che ogni contenuto digitale può avere un impatto reale.

Immagine di copertina, Copyright Free, realizzata con DALL-E