L’intelligenza artificiale sta rivoluzionando piano piano il modo di lavorare, di studiare e, in generale, la fruizione di internet e delle apparecchiature tecnologiche. Non solo l’applicazione principe di Open AI, ma anche tutte quelle applicazioni che stanno apportando notevoli vantaggi nella routine digitale quotidiana. Non si può parlare dei migliori modi per utilizzare ChatGPT, senza trattare anche e soprattutto gli usi scorretti di ChatGPT.

L’intelligenza artificiale, come per le medaglie, ha due facce. E quindi anche questa straordinaria tecnologia ha i suoi lati oscuri, che dipendono però anche e soprattutto da come si decide di utilizzarla, o meglio da cosa gli si chiede di fare. Mentre in precedenza ci si è concentrati sulle molteplici applicazioni e benefici dell’applicazione di Open AI, ora ci si immergerà negli usi Scorretti di ChatGPT, esplorando le situazioni in cui l’adozione di questa tecnologia potrebbe non essere ideale o addirittura dannosa.

1. Usi scorretti di ChatGPT: unico strumento decisionale in situazioni critiche o su temi sensibili

ChatGPT, con la sua capacità di elaborare e presentare informazioni, può tentare alcuni a utilizzarlo come principale punto di riferimento nelle decisioni. Ma nelle situazioni critiche, l’esperienza umana, l’intuito, la prudenza e una profonda competenza settoriale sono essenziali. Sebbene ChatGPT possa agire come un utilissimo strumento di supporto, fornendo dati e prospettive, è importante riconoscere che non dovrebbe mai essere l’unico arbitro o l’ultima parola in decisioni di grande importanza. La sua funzione dovrebbe rimanere quella di un complemento, una risorsa aggiuntiva, e non la principale guida nelle scelte critiche. Come il consiglio di un amico. Inoltre, mentre ChatGPT può sembrare estremamente convincente e informato, è vitale ricordare che non ha coscienza, intuizioni emotive o umane. Fare domande su temi estremamente sensibili o per ottenere consigli può rappresentare un fatto rischioso. Sebbene sia “addestrato” a dare la risposta più eticamente corretta, sebbene sia raro, potrebbe incappare in bias ed errori anche gravi. La piattaforma non possiede una coscienza autentica, né l’abilità di provare empatia o di percepire e interpretare il mondo attraverso intuizioni umane. Ogni risposta che genera, indipendentemente dalla sua complessità o apparente profondità, emerge da una serie di algoritmi sofisticati. Il rischio è di affezionarsi ai consigli di una macchina fino a distaccarsi completamente dalla realtà. Un po’ come succede agli Hikikomori.

2. Consigli Finanziari tramite ChatGPT? Uno degli usi scorretti più pericoloso

Sebbene possa offrire panorami generali sul mondo della finanza, ChatGPT non possiede la consapevolezza delle dinamiche attuali del mercato o delle specifiche esigenze finanziarie di un individuo. Ultimamente non è rarissimo leggere in rete “diventa ricco in un giorno grazie a ChatGPT”, ma lo stesso va considerato alla stregua di articoli che parlano di chi è diventato ricco con i gratta e vinci. Ma questo rappresenta un altro degli usi scorretti di ChatGPT. La finanza gestita da intelligenze artificiali, senza esperienza dell’utilizzatore, è la stessa che può essere fatta su App o pubblicità che promettono guadagni da investimenti facili. ChatGPT non ha la capacità di percepire e interpretare le dinamiche in tempo reale del mercato finanziario, né può fornire consulenze personalizzate. Non può individuare quindi i contesti unici e le specifiche esigenze finanziarie di un individuo. Non può capire quando si sta rischiando di perdere tutto né quando si stanno spendendo più soldi di quanti se ne possano permettere. Per una consulenza finanziaria robusta, i professionisti del settore sono insostituibili.

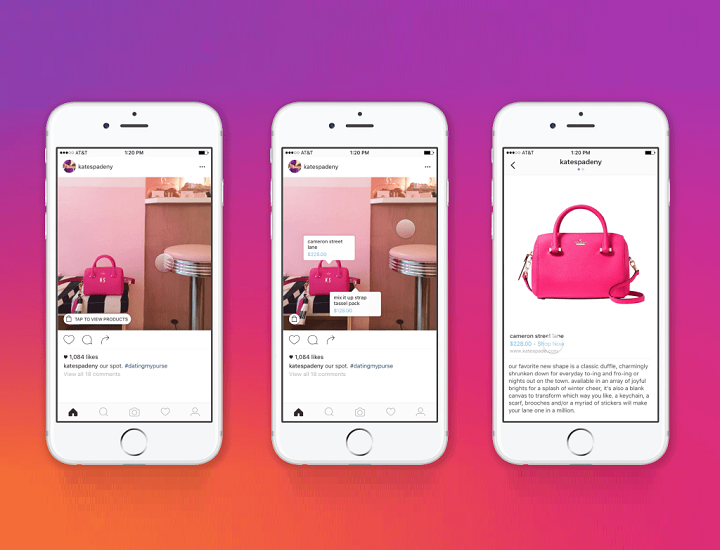

3. ChatGPT usato impropriamente come sostituto di interazioni umane

In un mondo sempre più digitalizzato, si potrebbe essere tentanti di affidarsi a ChatGPT per compagnia o per risposte emotive. Caryn Marjorie, una influencer molto famosa, ha lanciato il suo chatbot a pagamento basato sulla tecnologia di OpenAI. Questo bot simula una conversazione con lei attraverso messaggi vocali. A causa di richieste inappropriate, sono stati implementati dei filtri per bloccare contenuti sessuali. Senza arrivare a tanto, uno degli usi scorretti di ChatGPT riguarda proprio il sostituirlo ad una persona reale a livello sentimentale. La capacità di ChatGPT di rispondere prontamente e in modo apparentemente sensato può spingere alcuni a cercare in esso compagnia o addirittura consolazione emotiva in momenti di solitudine o incertezza. ChatGPT ha sempre una parola di conforto, un “in bocca a lupo” pronto per noi, quando altre persone sono distanti. Questo approccio, tuttavia, potrebbe trarre in inganno e portare le persone a considerarlo alla stregua di un essere vivente reale e senziente. Non c’è nulla di più sbagliato che affidarsi ad un Chatbot per conversare, se questo non viene fatto per curiosità o per semplice gioco.

4. Consigli medici o psicologici (scorretti) su ChatGPT

Se cercare i sintomi su Google non fosse già abbastanza pericoloso, ora entrano in gioco in questi temi anche le intelligenze artificiali. Strumenti come ChatGPT possono offrire spiegazioni e dettagli su una miriade di temi, compresi quelli legati alla medicina e alla psicologia. Tuttavia, è cruciale sottolineare che, nonostante la sua capacità di presentare informazioni generali su condizioni mediche o concetti psicologici, ChatGPT non è equipaggiato per fornire una diagnosi, consigli o un trattamento specifici e personalizzati. La salute e il benessere di un individuo sono complessi e multifattoriali, e richiedono un’attenta valutazione da parte di professionisti qualificati anche per semplici consigli o consulti. ChatGPT non dovrebbe mai sostituire un parere medico o terapeutico qualificato. La salute e il benessere necessitano di un approccio personalizzato, fornito da professionisti che hanno la formazione, l’esperienza e, soprattutto, la capacità di comprendere e rispondere alle esigenze uniche di ogni persona. Affidarsi a una fonte digitale per questioni di salute può comportare rischi significativi e potenzialmente gravi conseguenze.

5. ChatGPT per creare contenuti senza controllare le fonti

Sebbene abbia una conoscenza vastissima e pressoché infinita, gli usi scorretti di ChatGPT includono l’affidarsi ciecamente alle sue informazioni senza una dovuta verifica. La sua vasta base di conoscenza, seppur impressionante, non garantisce l’infallibilità. Il programma di Open AI è un potente algoritmo che cerca di comprendere la domanda e fornire la risposta più attendibile ma potrebbe non capire pienamente la domanda e fornire una risposta errata in tutto o in parte. Se viene utilizzato per la creazione di contenuti, inoltre, anche con un’accurata revisione, si rischierebbe di diffondere informazioni errate o imprecise. Oppure si potrebbe cadere nella violazione di Copyright, in quanto è impossibile avere la certezza che il testo generato non sia stato scritto in tutto o in parte da qualcun altro. Così come potrebbe inventare parte del testo. Se utilizzato per scrivere un testo o semplicemente per una ricerca, è di vitale importanza cercare una seconda opinione o una conferma da fonti esterne affidabili. Questa prudenza non solo garantisce una comprensione più accurata ma salvaguarda anche gli utenti da possibili misconoscimenti o informazioni fuorvianti.

6. Chiedere a ChatGPT cose illegali

Infine, è fondamentale sottolineare che rivolgersi a ChatGPT con richieste di natura illegale è altamente inadeguato oltre che pericoloso. Non solo rappresentano un grave abuso dell’intelligenza artificiale, ma anche un rischio tangibile per l’utente. La piattaforma stessa può riconoscere queste azioni e intervenire con un ammonimento, un ban dalla piattaforma e, nei casi più gravi, anche portare alla segnalazione alle autorità competenti, mettendo l’utente di fronte a possibili ripercussioni legali.

Conclusione

La tecnologia, in particolare l’intelligenza artificiale come ChatGPT, offre opportunità straordinarie per migliorare e semplificare la vita di tutti i giorni. Tuttavia, come ogni strumento, la sua efficacia dipende dal modo in cui viene usato. Bisogna evitare di cadere nelle trappole della sovrafiducia o della cattiva interpretazione. L’utilizzo responsabile e informato di ChatGPT può essere immensamente utile, ma è fondamentale ricordare che non può e non dovrebbe sostituire il giudizio, l’empatia e l’esperienza umana. In breve, come in ogni ambito, l’equilibrio è la chiave: sfruttare le potenzialità di questa tecnologia, ma con prudenza e consapevolezza.

Immagine Copyright Free generata con Midjourney